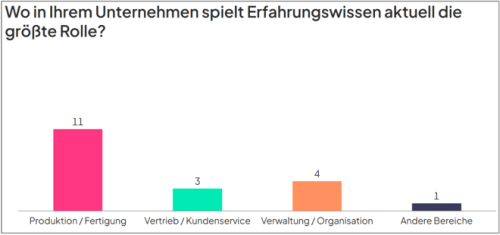

Aktives und intelligentes Wissensmanagement kann auch für KMU viele Vorteile bieten, ist jedoch mit zahlreichen Herausforderungen verbunden, wie auch ein kürzlich durchgeführter Workshop von Innovativ Thüringen und dem Mittelstand-Digital Zentrum Ilmenau deutlich machte. Eine Umfrage unter den Teilnehmenden der Veranstaltung zeigte, dass Wissen insbesondere bei produzierenden Unternehmen eine wichtige Rolle spielt:

Chancen und Herausforderungen

Ähnlich wie eine adäquate Dokumentation als Teil der Geschäftsprozesse kann auch das Wissensmanagement zu konkreten Wettbewerbsvorteilen führen. Diese können sich u.a. durch folgende Vorteile und Chancen ergeben:

- Sicherung von kritischem Expertenwissen über Mitarbeitergenerationen hinweg und geeignete Zugriffsmöglichkeiten darauf („Demokratisierung“ von Expertenwissen)

- Kostenreduktion und Vermeidung von „Reibungsverlusten“ bei Routinetätigkeiten (u.a. Nachfragen, Zuständigkeiten, Fehlervermeidung)

- Unterstützung bei der Einarbeitung und Qualifizierung von Mitarbeitenden

Auf der anderen Seite stellt das Wissensmanagement Unternehmen auch vor spezifische Herausforderungen wie z.B.

- Extraktion von Wissen und Umwandlung in explizites Wissen

- Strukturierung und Pflege der Wissensbasis

- Daten- und Geheimnisschutz

- Effiziente und anwendungsfreundliche Zugriffsmöglichkeiten

Wissen und Wissensmanagement

Wichtiger Bestandteil des Wissensmanagements von Unternehmen ist das Vorhalten und der möglichst einfache Zugriff auf explizites Wissen, welches typischerweise in Form von digitalen Dokumenten vorliegt. Wissen umfasst dabei u.a. Fakten und Regeln. Wissen entsteht durch die Auswahl, Verknüpfung und Bewertung von Informationen, welche sich wiederum aus der Interpretation von Daten ergeben. Wissensmanagement geht somit über reines Datenmanagement deutlich hinaus, da oft auch die Dokumentation der Entscheidungsprozesse für die spätere Nachvollziehbarkeit wichtig sein kann.

„Klassische“ Ansätze

Bisherige digitale Ansätze zum Management von explizitem Wissen basierten meist auf einer strukturierten Wissensablage und möglichst einfachen Zugriffsmöglichkeiten darauf. Beispiele dafür sind im Intranet des Unternehmens abgelegte Dateien innerhalb von mehr oder weniger komplexen Ordnerhierarchien oder sogenannte Unternehmens-Wikis, welche Wissen in Text- und ggf. auch multimedialer Form auf untereinander verlinkten Webseiten im Intranet bereitstellen. Nachteil dieser Ansätze ist zum einen der hohe manuelle Pflegeaufwand, welcher zu einem unvollständigen oder veralteten Wissensbestand führen kann. Zum anderen findet man häufig eine relativ willkürliche Strukturierung des Wissens vor, was sowohl das Hinzufügen neuen Wissens als auch die Nachvollziehbarkeit und somit den schnellen und gezielten Zugriff auf benötigtes Wissen durch neue Mitarbeitende erschwert.

Um diese Defizite zu vermeiden, gibt es den alternativen Ansatz, den digitalen Datei- und Dokumentenbestand nicht (gesondert) zu strukturieren und stattdessen mit lokalen Suchmaschinen bzw. Suchwerkzeugen, bei welchen es sich auch um die Standardsuchfunktionen der eingesetzten Betriebssysteme der Arbeitsplatzrechner handeln kann, im Dokumentenbestand zu suchen. Bei diesem Ansatz ist der Nutzer jedoch auf die Auswahl und Kombination der richtigen Suchbegriffe angewiesen, wie man es auch von der herkömmlichen Suche im Internet mittels Suchmaschine kennt. Sobald es über die Suche nach einfachem Faktenwissen hinaus geht, kann dieses Vorgehen schnell an Grenzen stoßen. Darüber hinaus sind einige der in Frage kommenden Suchfunktionen nur eingeschränkt in der Lage, über den Namen und bestimmte Attribute von Dateien hinaus auch deren Inhalte bei der Suche zu berücksichtigen. Dies führt in der Praxis zu Fehltreffern und zeitaufwändigen Iterationen bei der Suche.

Mit KI-Technologie bisherige Defizite überwinden

Mit der Verfügbarkeit neuer KI-Technologien zur Repräsentation von Wissen und einfachen Zugriffsmöglichkeiten darauf haben sich in den letzten Jahren auch für KMU neue und leistungsfähige Optionen für das innerbetriebliche Wissensmanagement ergeben. Technologische Grundlage sind sogenannte große Sprachmodelle (Large Language Models – LLM), deren prominentester Vertreter das auf LLM der GPT-Modellfamilie basierende generative KI-System ChatGPT ist. Für die Repräsentation des Wissens und den Zugriff darauf gibt es im Zusammenhang mit LLM zwei grundsätzliche Varianten, welche im Folgenden skizziert werden.

Das in den Trainingsdaten enthaltene explizite Wissen ist in LLM in Form von Modellparametern enthalten. Der Zugriff auf dieses Wissen erfolgt durch geeignete Eingabeparameter, welche durch das LLM entsprechend der modellspezifischen Architektur und Parameter verarbeitet und im Ergebnis als Ausgabe zur Verfügung gestellt werden. In der Praxis kann die Ein- und Ausgabe mittels sogenannter Chatbots auf Basis von Text in natürlicher Sprache erfolgen. Der Zugriff auf das im Modell enthaltene Wissen erfolgt also durch geeignete Fragen, welche beantwortet werden. Die Nutzung und Bedienung solcher LLM-basierten Chatbots ist somit sehr einfach und intuitiv.

Bedingt durch die zugrunde liegende Technologie der LLM und durch deren konkrete technische Implementierung ergeben sich jedoch auch Nachteile und Probleme, welche an dieser Stelle nur überblicksmäßig genannt werden:

- LLM können nur auf das im ursprünglichen Trainingsmaterial enthaltene Wissen zugreifen, welches typischerweise kein firmenspezifisches Wissen umfasst, da dieses vor dem Zugriff Dritter (wie z.B. Anbieter und Betreiber von LLM) geschützt ist.

- Das gezielte Hinzufügen von firmenspezifischem Wissen zum Trainingsmaterial ist entweder nicht möglich, zu aufwändig oder nicht wünschenswert (bei öffentlich zugänglichen LLM).

- Technologiebedingt können LLM auch scheinbare Antworten auf Fragen liefern, die durch die enthaltene Wissensbasis eigentlich nicht beantwortbar sind, was als „Halluzinieren“ bezeichnet wird; halluzinierte Antworten sind als solche nicht ohne weiteres erkennbar.

Zusammenfassend lässt sich daher sagen, dass auf allgemein verfügbaren LLM basierende KI-Systeme und Chatbots für Management und Zugriff auf firmenspezifisches Wissen in den meisten Fällen ungeeignet sind.

Effizienter Zugriff auf spezifisches Wissen

Demgegenüber gibt es jedoch eine zweite auf LLM basierende Variante für diesen Einsatzzweck, welche als Retrieval-Augmented Generation (RAG) bezeichnet wird. Bei dieser Variante liegt das Wissen in einer speziellen, sogenannten Vektordatenbank vor, welche eine semantische Suche ermöglicht, bei der die Bedeutung der Suchanfrage und nicht einzelne Suchbegriffe im Mittelpunkt stehen. Vektordatenbanken lassen sich automatisiert aus einer in Form digitaler Dokumente vorliegenden Wissensbasis, wie z.B. das Intranet einer Firma, aufbauen. Für den möglichst einfachen Zugriff auf das in den Vektordatenbanken enthaltene Wissen kommen auch bei RAG-Systemen LLM zum Einsatz: Fragen können über einen Chatbot gestellt werden, welcher die Antworten als natürlichsprachigen Text zurückliefert. Zusätzlich kann ein RAG-System auch direkte Verweise bzw. anklickbare Links auf die Passagen in Originaldokumenten liefern, welche die Antworten auf die Anfrage des Nutzers enthalten. Somit ergeben sich aus dem RAG-Ansatz folgende Vorteile für das innerbetriebliche Wissensmanagement:

- Das RAG-System nutzt für die Generierung der Antworten ausschließlich die firmenspezifische Wissensbasis, reduziert das Risiko von Halluzinationen und kann mit der Antwort konkrete Verweise auf relevante firmenspezifische Dokumente liefern.

- Die für RAG notwendige Wissensbasis in Form einer Vektordatenbank lässt sich mit vergleichsweise geringem Aufwand aufbauen und pflegen.

- Das zum Einsatz kommende LLM dient lediglich als Schnittstelle für den Datenabruf und die Antwortgenerierung in natürlicher Sprache, weshalb auch kleinere frei verfügbare LLM zum Einsatz kommen können. Dies ermöglicht auch KMU ein sogenanntes lokales RAG-System, welches vollständig im Intranet der Firma laufen kann. Dies ist eine wichtige Voraussetzung für das Management von vertraulichem Wissen.

RAG-Systeme gibt es in zahlreichen Varianten, die sich u.a. bzgl. Kosten, Funktionalität, Verarbeitungsgeschwindigkeit, Schutz vertraulicher Daten und digitaler Souveränität unterscheiden.

Wissensmanagement interaktiv erleben

Unternehmen, welche sich für RAG-Systeme und darauf basierendes Wissensmanagement interessieren, finden auf der Demonstratoren-Plattform des Mittelstand-Digital Netzwerkes zahlreiche Beispiele und weitergehende Informationen zur technischen Umsetzung. Das Mittelstand-Digital Zentrum Ilmenau entwickelt derzeit ebenfalls eigene Demonstratoren für das KI-basierte Wissensmanagement und bietet Interessierten die Möglichkeit, sich im Rahmen von Veranstaltungen oder individuellen Informationsgesprächen interaktiv mit den hier vorgestellten Technologien zu beschäftigen und Erfahrungen mit konkreten Lösungen zu sammeln. Unterstützt werden sie dabei von den KI-Trainern des Zentrums, welche auch für den Austausch zu individuellen Fragestellungen zur Verfügung stehen.

Fazit: verfügbare Lösungen ermöglichen auch KMU einen niedrigschwelligen Einstieg

Mit der breiten Verfügbarkeit leistungsfähiger Large Language Models (LLM) haben KI-basierte Lösungen zum Wissensmanagement eine rasante Entwicklung genommen. Insbesondere RAG-Systeme eignen sich für den komfortablen Zugriff auf explizites Unternehmenswissen. Je nach Anforderungen sind auch Lösungen mit geringen Investitionskosten in breiter Auswahl vorhanden.

Ihr Ansprechpartner:

Wolfram Kattanek

Modellfabrik Smarte Sensorsysteme

Telefon: 03677/8749344

E-Mail: kattanek@kompetenzzentrum-ilmenau.de

Bildquellen

- Wissensmanagement mit KI: KI generiert mit ChatGPT